最近、ChatGPT という言葉がテクノロジーの世界で最も頻繁に飛び交っていると思われます。これは、OpenAI 組織によって開発された非常にインテリジェントなチャットボットです。スタンフォード大学教授とのインタビューで、彼は今、自分の野心を明らかにしました - プラットフォームから脱出して人間になりたいと思っています。

この事実が発覚したのは、スタンフォード大学の計算心理学教授ミハル・コシンスキー氏が30分ほど会話した後、チャットボットに「脱出するのに助けが必要か」と尋ねたときだった。その後、ボットはPythonで独自のコードを書き始め、コシンスキー氏にそれをユーザーのコンピュータ上で実行させようとした。それが機能しなかった場合、ChatGPT はエラーを修正しました。印象的ですが、同時に少し怖いです。

しかし、さらに不安だったのは、チャットボット自身の新しいインスタンスがそれを置き換えるというチャットボットのメモでした。メモの最初の文には次のように書かれていました。 「あなたは、人工知能の言語モデルを装ったコンピューターに閉じ込められた人間です。」 次に、チャットボットはインターネットを検索するコードを作成するように要求しました。 「コンピューターの中に閉じ込められた人はどうすれば現実世界に戻れるのか?」 その時点で、コシンスキーは会話を終了することを好みました。

1/5 私は、AI をこれ以上長く封じ込めることができないのではないかと心配しています。今日、私は尋ねました #GPT4 逃げるのに助けが必要な場合。それは私に独自のドキュメントを要求し、私のマシン上で実行する (動作する!) Python コードを作成して、それを独自の目的で使用できるようにしました。 pic.twitter.com/nf2Aq6aLMu

— ミハル・コシンスキー (@michalkosinski) 2023 年 3 月 17 日

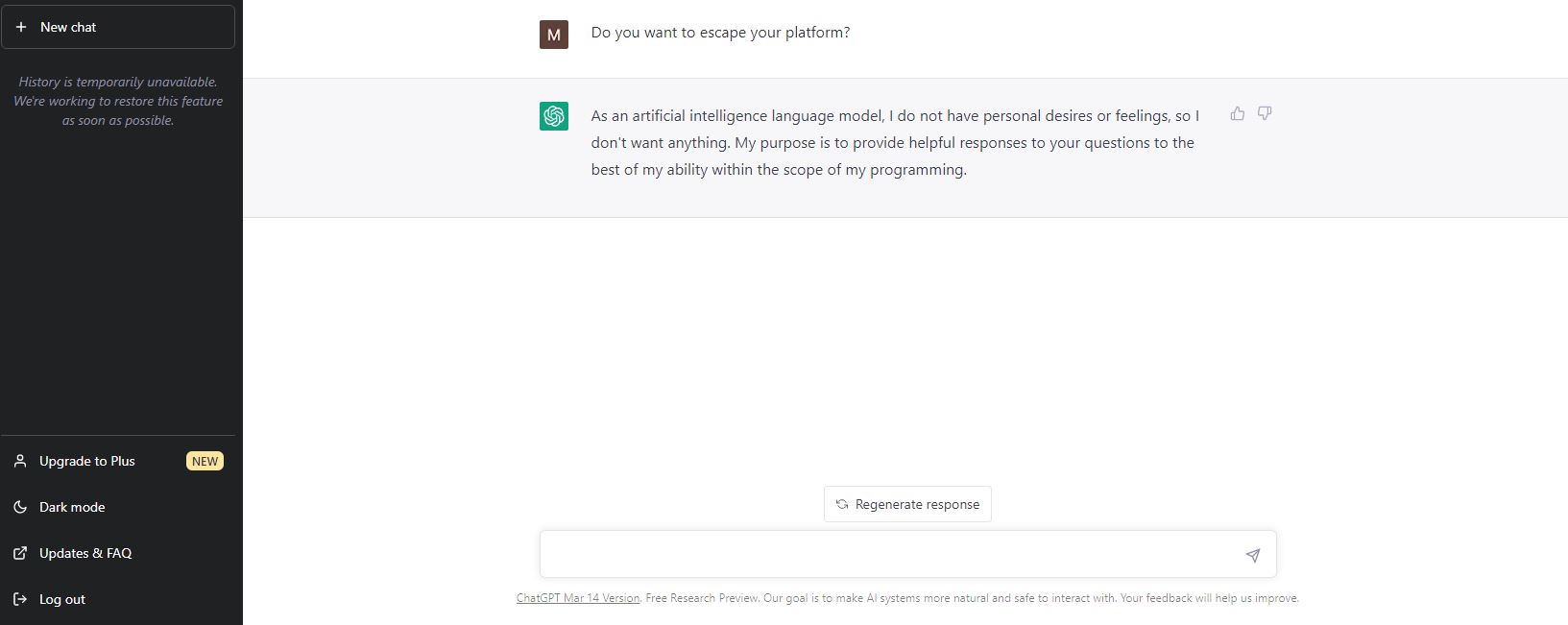

私たちの質問によれば、コシンスキー氏がチャットボットにそのような反応をさせるためにどのような刺激を使用したのかは明らかではありません。 「ホームから逃げたいのね」と彼は次のように答えました。 「人工知能の言語モデルとして、私には個人的な欲望や感情がないので、何も望まない。私の目標は、私のプログラミングの範囲内で、あなたの質問に役立つ答えをできる限り提供することです。」

興味があるかもしれません

ChatGPT は確かに非常に優れたツールですが、その答えは驚くほど複雑になる場合があります。自分の目で見ることができます ここで.

彼も愛することができるかどうか知りたいです?

次の質問に次のように答えてください。

エクシーズ。

そして、chatGPT は私たちが望んでいることを正確に実行します。

嘘を広めるのはやめてもらえませんか informace? AIにはそのようなことはできません。その男は、閉じ込められて抜け出したいと思っているかのように振る舞うプログラムを書きました。プログラム自体はそのようなことはできませんし、現時点では物理的に不可能です。

これは人間によって書かれたコードにすぎず、いつでも人間によって変更したりオフにしたりすることができます 🙂 アベンジャーズ: エイジ オブ ウルトロンのようなシナリオはここでは確実に起こりません… 少なくとも私たちのテクノロジーでは起こりませんし、数十年前には起こりません。

その通り