写真や動画に映る人物の顔を他人の顔に置き換えることを可能にする技術「ディープフェイク」は、近年、本物の映像と偽のデータの区別がますます複雑になる形に進化している。たとえば、ポルノ コンテンツを含むサイトでは、有名俳優の肖像を使った刺激的なビデオを作成するためにディープフェイクが使用されます。もちろん、これらすべては攻撃された人物の同意なしに行われており、機械学習を使用したテクノロジーがますます洗練されているおかげで、他の形態の悪用の可能性についての懸念が広がっています。ディープフェイクによって、裁判の証拠としてのデジタル記録の信頼性が完全に失墜する可能性があるという脅威は現実のものであり、ダモクレスの剣のように司法分野に迫っています。 Truepic から朗報が届きました。同社は、商品の信頼性を確認する簡単な方法を考案しました。

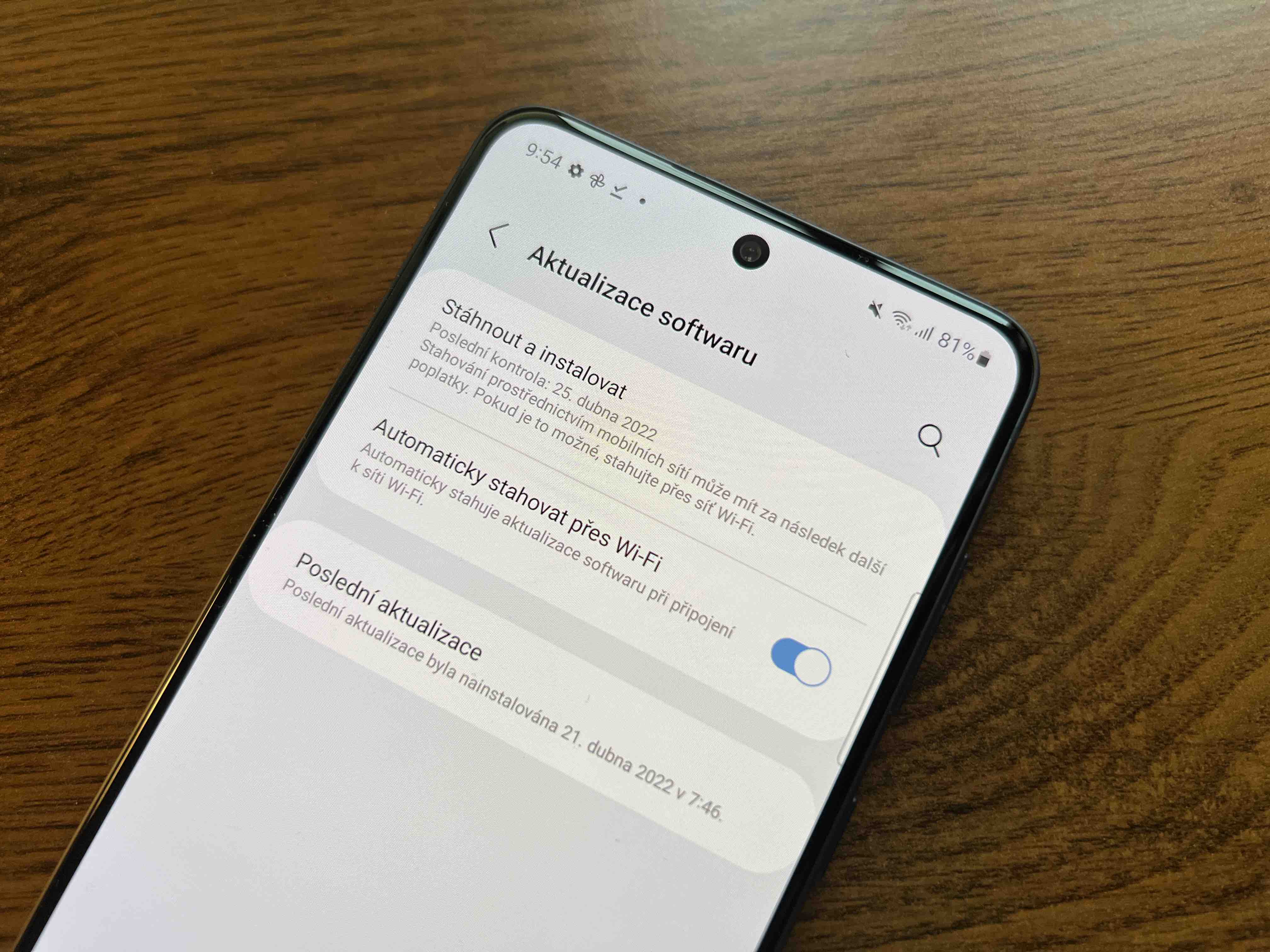

その作成者らはこの新技術を Foresight と呼び、追加のビデオ分析を行ってディープフェイクであるかどうかを判断する代わりに、個々の録画を作成されたハードウェアにリンクすることで信頼性を確保します。 Foresight は、暗号化されたメタデータの特別なセットを使用して作成されるすべてのレコードにタグを付けます。データは共通の形式で保存されます。 ページのプレビューで Android 警察 同社は、この方法で保護された画像を JPEG 形式で保存できることを実証しました。したがって、データ形式に互換性がないことを心配する必要はありません。

しかし、この技術は小さなハエの列に悩まされています。最も大きな問題は、おそらく、ファイルに加えられた変更がまだ記録されていないという事実です。解決策は、このセキュリティ方式をサポートするより多くの企業を参加させることです。したがって、この技術の成功は主に、サムスンとモバイル機器の最大手メーカーの関与によって決まります。 Applem. 誰かがあなたの外見を悪用するのではないかと心配していますか?記事の下のディスカッションでご意見をお聞かせください。